04. Introdución ao coñecemento básico da transmisión en directo

1. Recolle vídeo e audio

* 1.1 Capturar marco de codificación de vídeo e audio *

AVFoundation: AVFoundation é un marco para reproducir e crear datos de medios audiovisuais en tempo real. Tamén ofrece unha interface Objective-C para manipular estes datos audiovisuais, como a edición, rotación e recodificación

* 1.2 Equipos de hardware de vídeo e audio *

CCD: sensor de imaxe: úsase no proceso de adquisición e procesamento de imaxes para converter imaxes en sinais eléctricos.

Captación: sensor de son: úsase no proceso de recollida e procesamento de son, convertendo o son en sinais eléctricos.

Datos de mostra de audio: xeralmente en formato PCM

Datos de mostraxe de vídeo: xeralmente están en formato YUV ou RGB. O volume de audio e vídeo orixinal recollido é moi grande e necesita ser procesado por tecnoloxía de compresión para mellorar a eficiencia da transmisión

2. Procesamento de vídeo (beleza, marca de auga)

Principio de procesamento de vídeo: Debido a que o vídeo finalmente se representa na pantalla a través da GPU, fotograma a fotograma, podemos usar OpenGL ES para procesar os fotogramas de vídeo, de xeito que o vídeo teña varios efectos, igual que unha billa que sae A auga pasa por varios tubos e despois flúe cara a diferentes obxectivos

Agora todo tipo de beleza e vídeo engade aplicacións de efectos especiais implementadas usando o marco GPUImage.

* Marco de procesamento de vídeo *

GPUImage: GPUImage é un potente marco de procesamento de imaxe / vídeo baseado en OpenGL ES. Encapsula varios filtros e tamén pode escribir filtros personalizados. Incorporou máis de 120 efectos de filtro comúns.

OpenGL: OpenGL (Open Graphics Library completa) é unha especificación que define unha linguaxe de programación cruzada, interface de programación multiplataforma, que se usa para imaxes tridimensionais (tamén é posible bidimensional). OpenGL é unha interface de programa de gráficos profesional, unha poderosa biblioteca de gráficos subxacente de fácil chamada.

OpenGL ES: OpenGL ES (OpenGL para sistemas embebidos) é un subconxunto da API de gráficos OpenGL 3D, deseñado para dispositivos incrustados como teléfonos móbiles, PDA e consolas de xogos.

3. Codificación e descodificación de vídeo

* 3.1 Marco de codificación de vídeo *

FFmpeg: é un marco de vídeo de código aberto multiplataforma que pode implementar funcións enriquecidas como codificación de vídeo, descodificación, transcodificación, transmisión e reprodución. Os formatos de vídeo e protocolos de reprodución soportados son moi ricos, incluíndo case todos os códecs de audio e vídeo, formatos de encapsulamento e protocolos de reprodución.

-Libswresample: pode realizar operacións como resamostreo, rematrizado e conversión do formato de mostraxe do audio.

-LibavCodec: ofrece un framework de codec xeral, incluíndo moitos vídeos, audio, fluxos de subtítulos e outros codec / decodificadores.

-Libavformat: úsase para encapsular / descapsular o vídeo.

-Libavutil: contén algunhas funcións comúns, como xeración de números aleatorios, estrutura de datos, operacións matemáticas, etc.

-Libpostproc: úsase para algún postprocesamento do vídeo.

-Libswscale: úsase para a escala de imaxes de vídeo, conversión de espazo de cor, etc.

-Libavfilter: fornecer a función de filtro.

X264: codificación YuV e compresión dos datos de vídeo orixinais en formato H.264

VideoToolbox: a propia API de codificación dura e codificación de vídeo de Apple, pero só aberta despois de iOS8.

audioToolbox: a propia API de codificación dura de audio e codificación dura de Apple

* 3.2 Tecnoloxía de codificación de vídeo *

Estándares de codificación de compresión de vídeo: tecnoloxías de codificación para compresión de vídeo (codificación de vídeo) ou descompresión (decodificación de vídeo), como MPEG, H.264, estas tecnoloxías de codificación de vídeo son codificación por compresión de vídeo

Función principal: comprimir os datos do píxel de vídeo nun fluxo de vídeo, reducindo así a cantidade de datos de vídeo. Se o vídeo non está comprimido e codificado, o volume adoita ser moi grande e unha película pode requirir centos de xigabytes de espazo.

Nota: a calidade de vídeo que máis inflúe son os seus datos de codificación de vídeo e datos de codificación de audio, que nada teñen que ver co formato de empaquetado

MPEG: un método de compresión de vídeo que emprega compresión entre fotogramas, só almacenando as diferenzas entre fotogramas consecutivos, para conseguir unha relación de compresión maior

H.264 / AVC: un método de compresión de vídeo que usa a predición previa e o mesmo método de predición de fotogramas que o fotograma PB en MPEG. Pode xerar un fluxo de vídeo adecuado para a transmisión de rede segundo as necesidades e ten unha relación de compresión máis alta. Ten mellor calidade de imaxe

Nota 1: se comparas a definición dunha única pantalla, mpeg4 ten unha vantaxe; a partir da definición de continuidade de acción, H.264 ten unha vantaxe

Nota 2: Debido a que o algoritmo de 264 é máis complexo, o programa é complicado de implementar e precisa máis recursos de procesador e memoria para executalo. Polo tanto, executar 264 require uns requisitos de sistema relativamente altos.

Nota 3: Debido a que a implementación de 264 é máis flexible, deixa algunhas implementacións aos propios fabricantes. Aínda que isto supón moitos beneficios para a implementación, a intercomunicación entre diferentes produtos converteuse nun gran problema, o que resulta na adopción da compañía A. Os datos compilados polo codificador deben resolvelos o descodificador da compañía A para resolver cousas tan vergoñentas.

H.265 / HEVC: método de compresión de vídeo baseado en H.264, que conserva algunhas das tecnoloxías orixinais, á vez que mellora algunhas tecnoloxías relacionadas para mellorar a relación entre fluxo de bits, calidade de codificación, atraso e complexidade do algoritmo. Relacións para acadar a configuración óptima.

H.265 é un estándar de codificación máis eficiente que pode comprimir o volume do contido a un tamaño menor co mesmo efecto de calidade de imaxe e transmitir máis rápido e aforrar ancho de banda.

Marco: (marco clave) gardo unha imaxe completa, só necesito os datos deste marco para completar a descodificación (porque contén a imaxe completa

Marco P: (marco diferencial) Mantense a diferenza entre este marco e o marco anterior. Ao descodificar, a imaxe previamente almacenada no buffer debe superpoñerse á diferenza definida por este marco para xerar a imaxe final. (O cadro P non ten datos de imaxe completos, só os datos que son diferentes do cadro anterior)

Marco B: (marco de diferenza de dobre sentido) conserva a diferenza entre o marco actual e o anterior e o seguinte. Para decodificar o marco B, non só se debe obter a imaxe previamente almacenada no buffer, senón tamén a imaxe descodificada. O resultado final obtense mediante a superposición das imaxes dianteira e traseira e os datos actuais do cadro Imaxe. A taxa de compresión de fotogramas B é alta, pero a CPU estará máis cansa ao descodificar

Compresión intra-fotograma: ao comprimir un fotograma de imaxe, só se consideran os datos deste fotograma sen considerar a información redundante entre fotogramas adxacentes. Xeralmente, utilízase un algoritmo de compresión con perdas no cadro

Compresión InteRFrame: compresión temporal, que comprime datos comparando datos entre diferentes fotogramas do eixe temporal. A compresión entre fotogramas é xeralmente sen perdas

muxing (síntese): encapsula fluxos de vídeo, fluxos de audio e incluso fluxos de subtítulos nun ficheiro (formato contedor (FLV, TS)) e transmíteo como sinal.

* 3.3 Tecnoloxía de codificación de audio *

AAC, mp3: son tecnoloxías de codificación de audio, usadas para audio comprimido

* 3.4 Control da taxa *

Múltiples taxas de bits: a situación da rede na que se atopa o público é moi complicada, pode ser WiFi, pode ser 4G, 3G ou incluso 2G, entón como satisfacer as necesidades de varias partes? Constrúe algunhas liñas máis e personaliza a taxa de bits segundo o ambiente de rede actual.

Por exemplo: adoito ver 1024, 720, HD, SD, suave, etc. no software de reprodución de vídeo, que fai referencia a varias velocidades de bits.

* 3.5 Formato de empaquetado de vídeo *

TS: un formato de encapsulación de medios de transmisión. A encapsulación multimedia en streaming ten a vantaxe de non ter que cargar o índice antes de reproducir, o que reduce moito o atraso da primeira carga. Se a película é relativamente longa, o índice do ficheiro mp4 é bastante grande, o que afecta á experiencia do usuario

Por que usar TS: Isto débese a que dous clips TS poden combinarse perfectamente e o xogador pode xogar continuamente

FLV: formato de encapsulación de medios de transmisión. Debido ao tamaño do ficheiro extremadamente pequeno e á velocidade de carga extremadamente rápida, permite ver ficheiros de vídeo en Internet. Polo tanto, o formato FLV converteuse no formato de vídeo principal na actualidade.

4. Push Stream

* 4.1 Marco de transmisión de datos *

librtmp: úsase para transmitir datos en formato de protocolo RTMP

* 4.2 Protocolo de transmisión de datos multimedia en streaming *

RTMP: protocolo de mensaxería en tempo real, un protocolo aberto desenvolvido por Adobe Systems para a transmisión de audio, vídeo e datos entre reprodutores Flash e servidores. Debido a que é un protocolo aberto, pódese usar todo.

O protocolo RTMP úsase para a transmisión de obxectos, vídeo e audio.

Este protocolo está construído sobre o protocolo TCP ou o protocolo HTTP de sondeo.

O protocolo RTMP é como un contedor usado para manter paquetes de datos. Estes datos poden ser datos audiovisuais en FLV. Unha única conexión pode transmitir múltiples fluxos de rede a través de diferentes canles e os paquetes destas canles transmítense en paquetes de tamaño fixo

chunk: paquete de mensaxes

5. Servidor multimedia en streaming

* 5.1 Servidores de uso común *

SRS: un excelente sistema de servidor multimedia de streaming de código aberto desenvolvido por chinés

BMS: tamén é un sistema de servidor multimedia en streaming, pero non de código aberto. É unha versión comercial de SRS e ten máis funcións que SRS

nginx: servidor web de código aberto e gratuíto, usado normalmente para configurar servidores multimedia de transmisión.

* 5.2 Distribución de datos *

CDN: (Content Delivery Network), a rede de entrega de contido, publica o contido do sitio web ao "bordo" da rede máis próxima ao usuario, para que o usuario poida obter o contido desexado nas proximidades, resolve a conxestión da rede de Internet , e mellora o acceso do usuario á velocidade de resposta do sitio web.

CDN: servidor proxy, equivalente a un intermediario.

O principio de traballo de CDN: como solicitar a transmisión de datos multimedia

1. Cargar datos multimedia en streaming ao servidor (sitio de orixe)

2. A estación de orixe almacena datos multimedia en streaming

3. O cliente reproduce o contido multimedia en streaming e solicita os datos multimedia en streaming codificados desde a CDN

4. O servidor CDN responde á solicitude. Se os datos multimedia en streaming non existen no nodo, seguirá solicitando os datos multimedia en streaming desde a estación de orixe; se o ficheiro de vídeo xa está almacenado na caché no nodo, pase ao paso 6.

5. O sitio de orixe responde á solicitude de CDN e distribúe o soporte de transmisión ao nodo CDN correspondente

6. A CDN envía datos multimedia ao cliente

Volver á orixe: cando un usuario visita un determinado URL, se o nodo CDN analizado non caché o contido da resposta ou a caché caducou, volverá ao sitio de orixe para obter a busca. Se ninguén visita, entón o nodo CDN non irá activamente ao sitio de orixe para obtelo.

Ancho de banda: a cantidade total de datos que se poden transmitir nun tempo fixo,

Por exemplo, un bus frontal de 64 bits e 800 MHz, a súa velocidade de transferencia de datos é igual a 64 bits × 800 MHz ÷ 8 (Byte) = 6.4 GB / s

Equilibrio de carga: un conxunto de servidores está composto por varios servidores de xeito simétrico. Cada servidor ten un estado equivalente e pode proporcionar servizos de forma independente sen a axuda doutros servidores.

A través dunha determinada tecnoloxía de compartición de carga, as solicitudes enviadas desde o exterior distribúense uniformemente a un determinado servidor na estrutura simétrica e o servidor que recibe a solicitude responde de xeito independente á solicitude do cliente.

O equilibrio de carga pode distribuír de xeito uniforme as solicitudes dos clientes á matriz do servidor, proporcionando así acceso rápido a datos importantes e resolvendo o problema dun gran número de servizos de acceso simultáneo.

Esta tecnoloxía de clúster pode acadar un rendemento próximo ao dun mainframe cun investimento mínimo.

QoS (xestión de ancho de banda): limita o ancho de banda de cada grupo, de xeito que o ancho de banda limitado poida usarse co seu máximo efecto

6. Tirar fluxo

Selección de protocolo de transmisión en directo:

RTMP, RTSP pode usarse para aqueles con altos requirimentos en tempo real ou necesidades interactivas

Para aqueles con requisitos de reprodución ou multiplataforma, recoméndase HLS

Comparación do protocolo de transmisión en directo: (5)

HLS: protocolo para transmisión en tempo real definido por Apple. HLS está implementado baseado no protocolo HTTP. O contido da transmisión inclúe dúas partes, unha é o ficheiro de descrición M3U8 e a outra é o ficheiro multimedia TS. Pode realizar a transmisión en directo e baixo demanda, empregada principalmente no sistema iOS

HLS é conseguir a transmisión en directo por tecnoloxía baixo demanda

HLS é unha transmisión de velocidade de bits adaptativa. O cliente seleccionará automaticamente fluxos de vídeo con diferentes velocidades de bits segundo as condicións da rede. Use taxas de bits altas se as condicións o permiten e use taxas de bits baixas cando a rede está ocupada e cambie automaticamente as dúas ao seu antollo.

cambio. Isto é moi útil para garantir unha reprodución fluída cando as condicións de rede do dispositivo móbil son inestables.

O método de implementación é que o servidor fornece un fluxo de vídeo de varias velocidades de bits e nótase no ficheiro da lista e o reprodutor axústase automaticamente segundo o progreso da reprodución e a velocidade de descarga.

Comparación de HLS e RTMP: HLS débese principalmente a un atraso relativamente grande e a principal vantaxe de RTMP é a baixa latencia

O método de pequena porción do protocolo HLS xerará unha gran cantidade de ficheiros e almacenar ou procesar estes ficheiros causará moitos desperdicios de recursos

En comparación co protocolo SP, a vantaxe é que unha vez completada a segmentación, o proceso de distribución posterior non precisa empregar ningún software especial. Un servidor de rede normal é suficiente, o que reduce en gran medida os requisitos de configuración do servidor CDN edge e pódese usar calquera CDN xa feito. E os servidores xerais raramente admiten RTSP.

HTTP-FLV: streaming de contido multimedia baseado no protocolo HTTP.

En comparación con RTMP, HTTP é máis sinxelo e coñecido, o atraso do contido tamén pode ser de 1 a 3 segundos e a velocidade de apertura é máis rápida, porque HTTP en si non ten unha interacción de estado complexa. Polo tanto, desde a perspectiva da latencia, HTTP-FLV é mellor que RTMP.

RTSP: protocolo de transmisión en tempo real, define como as aplicacións de un a moitos poden transmitir efectivamente datos multimedia a través dunha rede IP.

RTP: protocolo de transporte en tempo real. RTP está construído sobre o protocolo UDP e úsase a miúdo xunto con RTCP. Non proporciona mecanismos de entrega puntuais nin outras garantías de calidade de servizo (QoS). Para lograr este proceso, confía en servizos de baixo nivel.

RTCP: protocolo de apoio de RTP, a función principal é proporcionar información sobre a calidade do servizo (QoS) proporcionada por RTP e recompilar información estatística sobre a conexión multimedia, como o número de bytes transmitidos, o número de paquetes transmitidos, o número de paquetes perdidos, redes unidireccionais e bidireccionais Atraso, etc.

7. Descodificación

* 7.1 Decapsulación *

Demuxing (separación): descompón o vídeo, o audio ou os subtítulos do ficheiro (formato contedor (FLV, TS)) sintetizado a partir do fluxo de vídeo, fluxo de audio e fluxo de subtítulos e descodifícaos por separado.

* 7.2 Marco de codificación de audio *

fdk_aac: marco de codificación e decodificación de audio, datos de audio PCM e conversión de datos de audio AAC

* 7.3 Introdución á descodificación *

Descodificación dura: usa a GPU para decodificar e reducir as operacións da CPU

Vantaxes: reprodución fluída, baixo consumo de enerxía, velocidade de decodificación rápida,

* Inconvenientes: mala compatibilidade

Descodificación suave: usa a CPU para decodificar

Vantaxes: boa compatibilidade

* Desvantaxes: aumento da carga da CPU, aumento do consumo de enerxía, sen hardware

Decodificación suave, velocidade de descodificación relativamente lenta

8. Xoga

ijkplayer: un reprodutor de vídeo Android / iOS de código aberto baseado en FFmpeg

A API é fácil de integrar;

A configuración da compilación pódese cortar para facilitar o control do tamaño do paquete de instalación;

Admite a descodificación de aceleración de hardware, máis aforro de enerxía

Sinxelo e sinxelo de usar, especifica a URL de transmisión, descodifica e reproduce automaticamente.

9. Interacción de chat

IM: (InstantMessaging) Mensaxería instantánea: é un sistema de comunicación en tempo real que permite que dúas ou máis persoas poidan utilizar a rede para comunicarse en mensaxes de texto, ficheiros, voz e vídeo en tempo real.

O papel principal da mensaxería instantánea no sistema de transmisión en directo é realizar a interacción do texto entre a audiencia e a áncora e entre a audiencia e a audiencia.

* SDK de terceiros *

Tencent Cloud: SDK de mensaxería instantánea fornecido por Tencent, que se pode usar como sala de chat en directo

Rongyun: un SDK de mensaxería instantánea de uso común que se pode usar como sala de chat en directo

5. Como desenvolver rapidamente unha aplicación completa de transmisión en directo de iOS

1. Use o SDK de transmisión en directo de terceiros para un desenvolvemento rápido

Qiniu Cloud: Qiniu Live Cloud é un servizo de transmisión en directo global creado específicamente para plataformas de transmisión en directo e unha plataforma de servizos de transmisión en directo a nivel empresarial que implementa escenarios de transmisión en directo SDK de extremo a extremo.

* As plataformas de transmisión en directo como Panda TV e Dragon Ball TV usan Qiniu Cloud

NetEase Video Cloud: baseado na tecnoloxía profesional de códecs de vídeo multiplataforma e na rede de distribución de contido de vídeo a gran escala, ofrece servizos de audio e vídeo en tempo real estables, suaves, de baixa latencia e de alta concorrencia e pode conectar sen problemas vídeo en directo a a súa propia aplicación.

2. Por que empresas SDK de terceiras partes nos proporcionan SDK?

Esperamos amarrar o noso produto ao mesmo barco e confiar máis nel.

A tecnoloxía gaña cartos e axuda a recadar un gran número de programadores

3. Función de transmisión en directo: autoinvestigarse ou utilizar desenvolvemento de SDK de transmisión en directo de terceiros?

Desenvolvemento de SDK de terceiros: para un equipo inicial, a transmisión en directo autodesenvolvida ten un limiar grande en termos de limiar técnico, CDN e ancho de banda, e leva moito tempo facer un produto acabado, o que non é propicio ao investimento.

Auto-investigación: a plataforma de transmisión en directo da compañía é grande. A longo prazo, a autoinvestigación pode aforrar custos e os aspectos técnicos son moito máis controlables que o uso directo do SDK.

4. Beneficios do SDK de terceiros

abarate o custo

Use bos servizos corporativos de terceiros, xa non terá que gastar prezos altos para contratar cazadores de cabezas para cavar vacas grandes caras e non hai que calmar o temperamento persoal das vacas grandes.

Mellorar a eficiencia

O foco dos servizos de terceiros e a comodidade que ofrece a integración de código só poden levar 1-2 horas, o que aforra case o 99% do tempo, o que é suficiente a cambio de máis tempo para loitar contra os competidores e aumentar máis. Gran posibilidade de éxito

reducir o risco

Coa axuda de servizos profesionais de terceiros, debido ás súas características rápidas, profesionais, estables e outras, pode mellorar moito a competitividade dos produtos (servizos de alta calidade, velocidade de investigación e desenvolvemento, etc.) e acurtar a proba e o tempo de erro, que seguramente será un dos medios para salvar vidas no emprendemento.

|

|

|

|

Como distante (long) a tapa do transmisor?

A franxa de transmisión depende de moitos factores. A distancia real baséase na altura da antena de instalar, a ganancia da antena, usando ambiente como a construción e outras obturacións, a sensibilidade do receptor, a antena do receptor. Instalación de antena máis alta e usando o campo, a distancia vai moito máis lonxe.

EXEMPLO 5W FM Transmitter usar na cidade e cidade natal:

Teño un uso do cliente 5W transmisor FM EUA con antena GP na súa cidade natal, e proba-lo con un coche, cubrir 10km (6.21mile).

I probar o transmisor FM 5W con antena GP na miña cidade natal, que cobren aproximadamente 2km (1.24mile).

I probar o transmisor FM 5W con antena GP na cidade de Guangzhou, que abranguen aproximadamente única 300meter (984ft).

Abaixo amósanse ao descanso aproximado de diferentes transmisores de enerxía FM. (O intervalo é de diámetro)

0.1W ~ 5W Transmisor FM: 100M ~ 1KM

5W ~ 15W FM Ttransmitter: 1KM ~ 3KM

15W ~ 80W Transmisor FM: 3KM ~ 10KM

80W ~ 500W Transmisor FM: 10KM ~ 30KM

500W ~ 1000W Transmisor FM: 30KM ~ 50KM

1KW ~ 2KW Transmisor FM: 50KM ~ 100KM

2KW ~ 5KW Transmisor FM: 100KM ~ 150KM

5KW ~ 10KW Transmisor FM: 150KM ~ 200KM

Como contactar connosco para o transmisor?

Chama-me + 8618078869184 OU

Enviar email me [protexido por correo electrónico]

1.How lonxe quere cubrir de diámetro?

2.How altura de torre ti?

3.Where es?

E imos dar-lle consellos máis profesional.

Sobre nós

FMUSER.ORG é unha empresa de integración de sistemas centrada en equipos de transmisión / transmisión de audio sen fíos de radio / estudio de vídeo e procesamento de datos. Estamos ofrecendo todo desde asesoramento e consultoría a través da integración de rack ata a instalación, posta en servizo e adestramento.

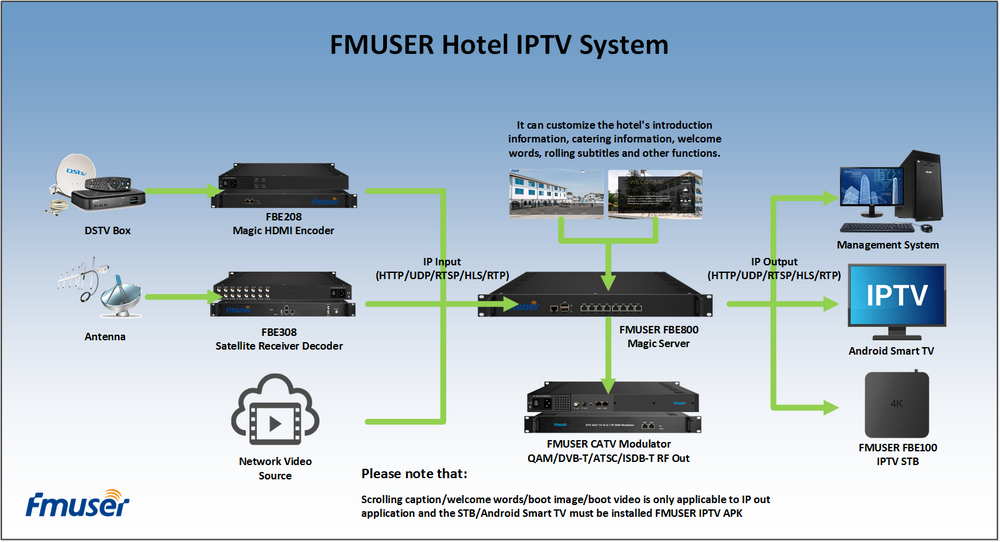

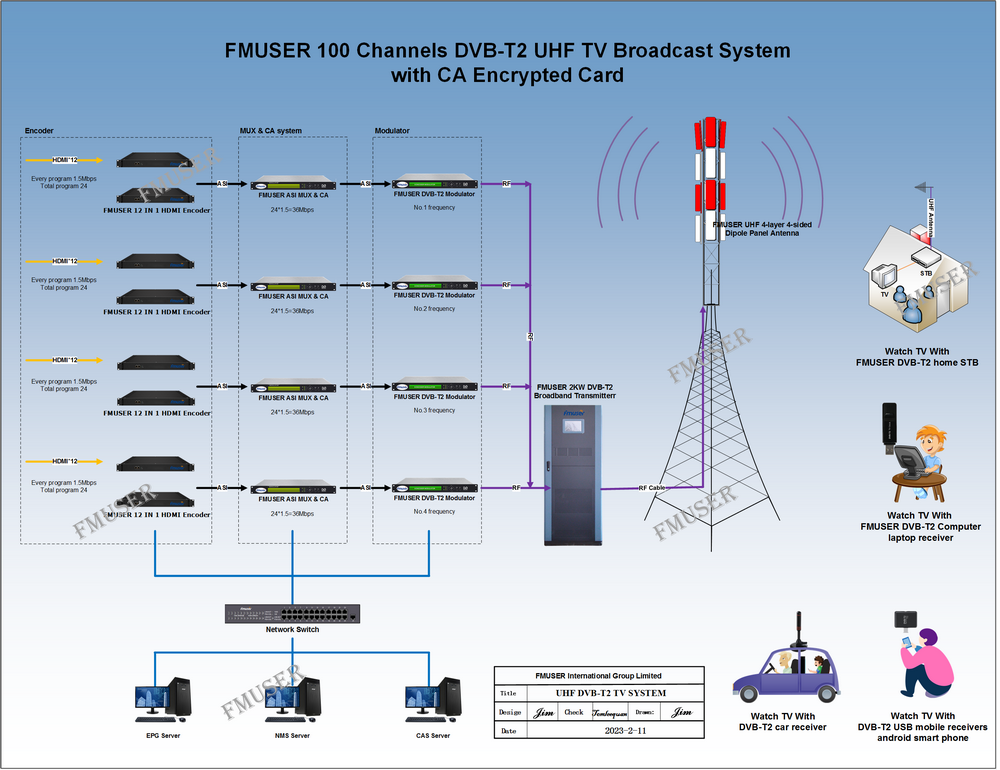

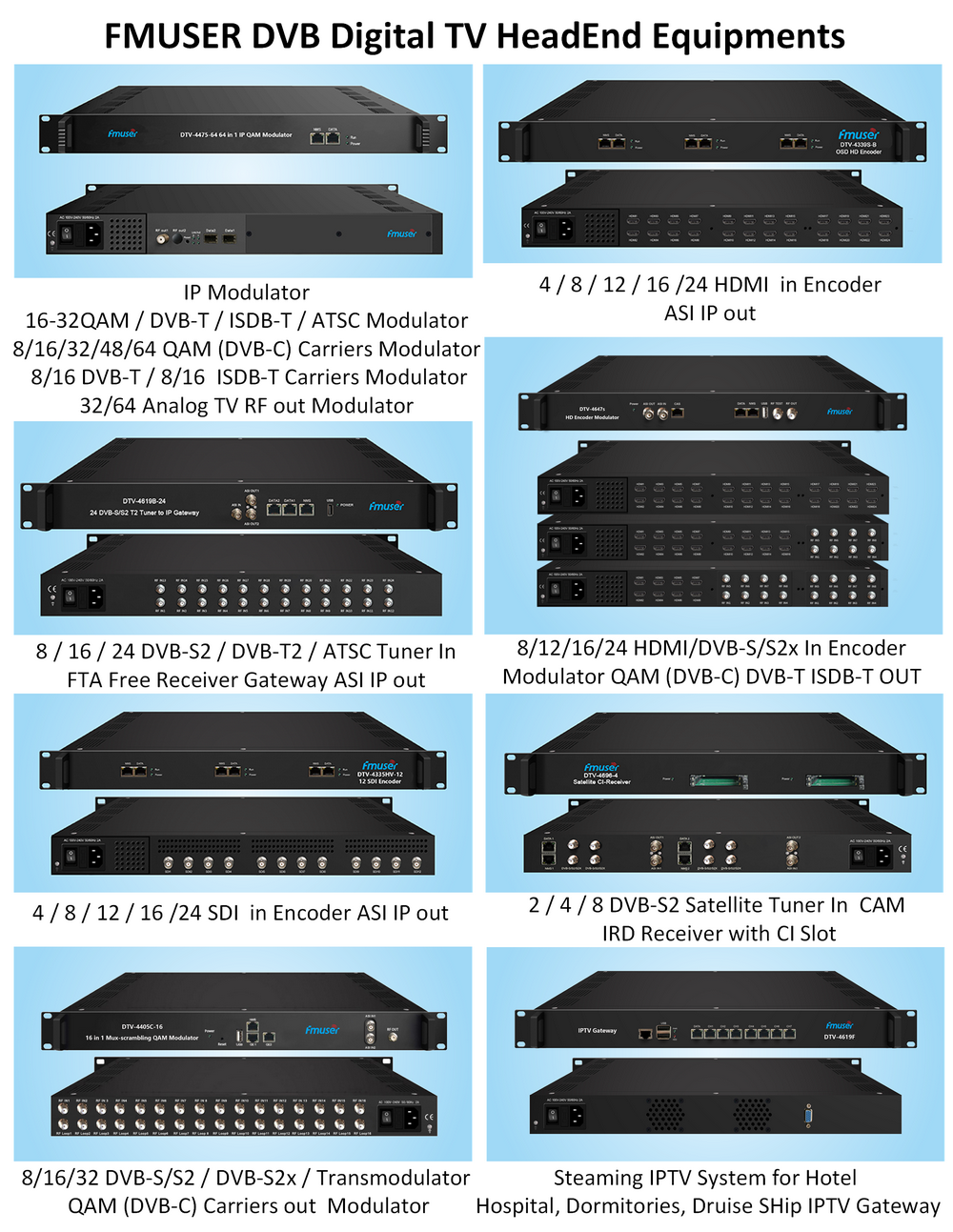

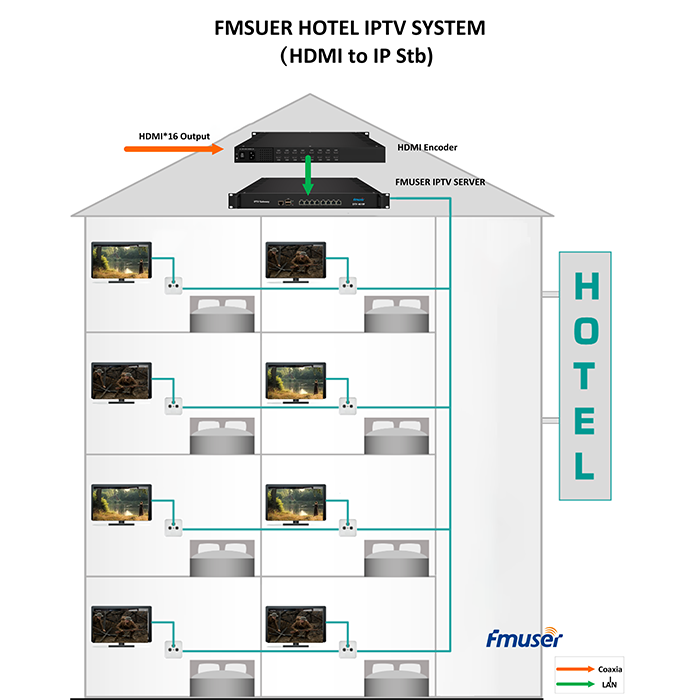

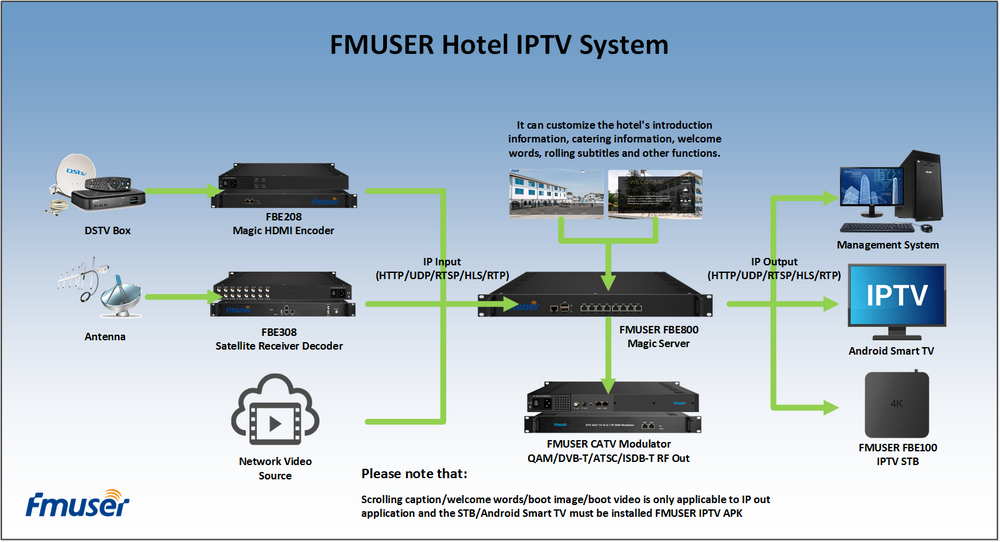

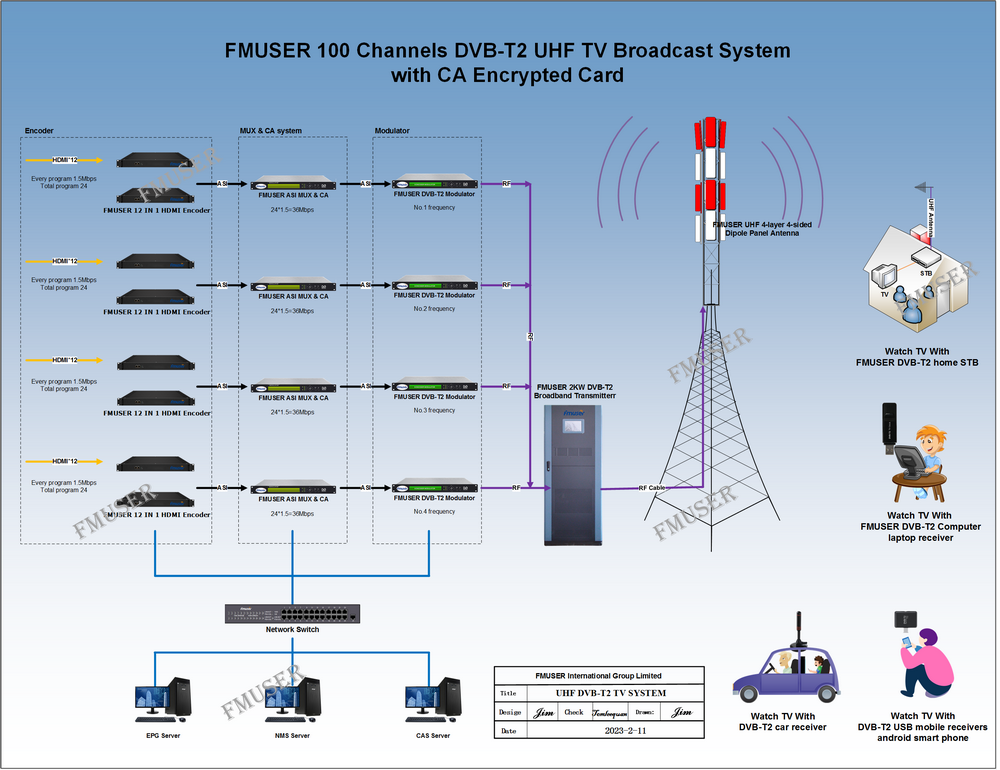

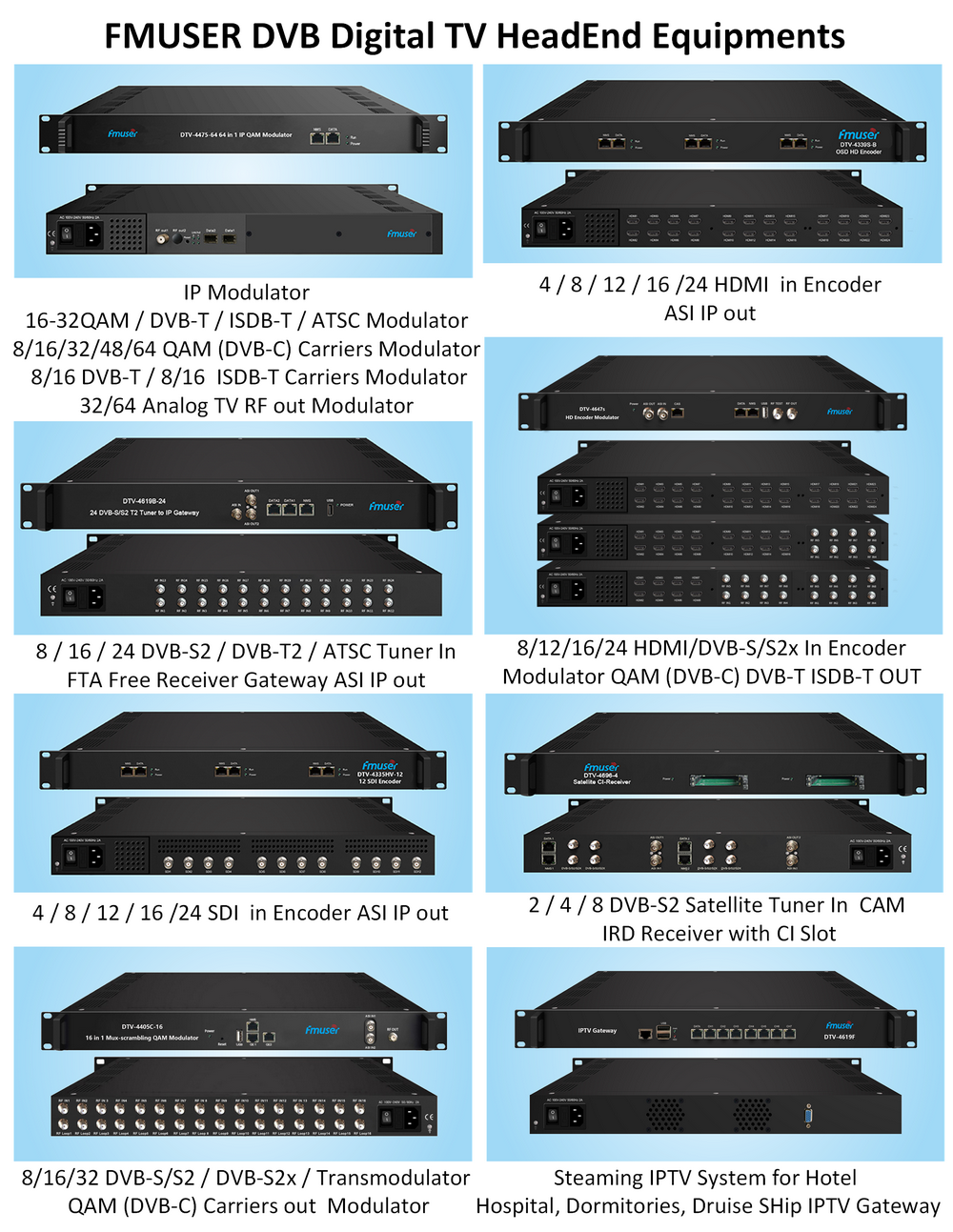

Ofrecemos transmisor de FM, transmisor de TV analóxico, transmisor de TV dixital, transmisor UHF de VHF, antenas, conectores de cable coaxial, STL, procesamento de aire, produtos de transmisión para o estudio, monitorización de sinais de RF, codificadores de RDS, procesadores de audio e unidades de control de sitios remotos. Produtos IPTV, codificador / decodificador de audio / vídeo, deseñados para satisfacer as necesidades de grandes redes de transmisión internacionais e pequenas estacións privadas.

A nosa solución ten estación de radio FM / estación de televisión analóxica / estación de TV dixital / equipos de estudio de vídeo e vídeo / enlace de transmisión de estudio / sistema de telemetría de transmisor / sistema de TV de hotel / transmisión en directo IPTV / transmisión en directo de transmisión / conferencia de vídeo / sistema de transmisión CATV.

Estamos a usar produtos de tecnoloxía avanzada para todos os sistemas, porque sabemos que a alta fiabilidade e alto rendemento son tan importantes para o sistema e a solución. Ao mesmo tempo, temos que asegurarnos que o noso sistema de produtos a un prezo moi razoable.

Temos clientes de radiodifusores públicos e comerciais, operadores de telecomunicacións e autoridades reguladoras, e tamén ofrecemos solucións e produtos a moitos centos de emisoras locais e comunitarias máis pequenas.

FMUSER.ORG leva máis de 15 anos exportando e ten clientes en todo o mundo. Con 13 anos de experiencia neste campo, temos un equipo profesional para resolver todo tipo de problemas do cliente. Dedicámonos a ofrecer prezos extremadamente razoables de produtos e servizos profesionais. Correo electrónico de contacto: [protexido por correo electrónico]

nosa fábrica

Temos modernización da fábrica. Estás convidado a visitar a nosa fábrica cando chegar a China.

Actualmente, xa existen clientes 1095 en todo o mundo visitan nosa oficina Guangzhou Tianhe. Se ve a China, está invitado a visitar-nos.

na Feira

Esta é a nosa participación en 2012 Global Sources Hong Kong Fair Electrónica . Clientes de todo o mundo finalmente ter a oportunidade de estar xuntos.

Onde está Fmuser?

Podes buscar nestes números " 23.127460034623816,113.33224654197693 "en google map, entón podes atopar a nosa oficina fmuser.

oficina FMUSER Guangzhou está Tianhe District, que é a centro do cantón . moi preto ao Feira de Cantón , Estación ferroviaria Guangzhou, estrada Xiaobei e dashatou , Só ten minutos 10 tomar TAXI . Benvidos amigos de todo o mundo a visitar e negociar.

Contacto: Ceo azul

Móbil: + 8618078869184

WhatsApp: + 8618078869184

Wechat: + 8618078869184

E-mail: [protexido por correo electrónico]

QQ: 727926717

Skype: sky198710021

Dirección: No.305 cuarto Huilan Edificio No.273 Huanpu Estrada Guangzhou China Zip: 510620

|

|

|

|

Inglés: Aceptamos todos os pagos, como PayPal, tarxeta de crédito, Western Union, Alipay, Money Bookers, T / T, LC, DP, DA, OA, Payoneer, Se tes algunha pregunta, póñase en contacto comigo [protexido por correo electrónico] ou WhatsApp + 8618078869184

-

PayPal.  www.paypal.com www.paypal.com

Recomendamos que use Paypal para mercar os nosos produtos, PayPal é unha forma segura de mercar en internet.

Cada da nosa lista de elementos de páxina de fondo na parte superior ten un logotipo PayPal para pagar.

Tarxeta de crédito.Se non ten paypal, pero ten tarxeta de crédito, tamén se pode facer clic no botón amarelo PayPal para pagar coa súa tarxeta de crédito.

-------------------------------------------------- -------------------

Pero se non ten unha tarxeta de crédito e non ten unha conta PayPal ou de difícil ten un accout PayPal, pode utilizar o seguinte:

Western Union.  www.westernunion.com www.westernunion.com

Pago por Western Union para min:

Nome / nome: Yingfeng

Apelido / Apelido / Apelido: Zhang

Nome completo: Yingfeng Zhang

País: China

Cidade: Guangzhou

|

-------------------------------------------------- -------------------

T / T. pago por T / T (transferencia bancaria / transferencia telegráfica / Transferencia bancaria)

Primeira información bancaria (conta da empresa):

SWIFT BIC: BKCHHKHHXXX

Nome do banco: BANK OF CHINA (HONG KONG) LIMITED, HONG KONG

Enderezo bancario: BANK OF CHINA TOWER, 1 GARDEN ROAD, CENTRAL, HONG KONG

CÓDIGO BANCO: 012

Nome da conta: FMUSER INTERNATIONAL GROUP LIMITED

Conta NON. : 012-676-2-007855-0

-------------------------------------------------- -------------------

Segunda INFORMACIÓN BANCARIA (CONTA DA EMPRESA):

Beneficiario: Fmuser International Group Inc.

Número de conta: 44050158090900000337

Banco do beneficiario: China Construction Bank Sucursal de Guangdong

Código SWIFT: PCBCCNBJGDX

Enderezo: estrada Tianhe NO.553, Cantón, Guangdong, distrito de Tianhe, China

** Nota: cando transfira cartos á nosa conta bancaria, NON escriba nada na área de comentarios, se non, non poderemos recibir o pago debido á política gobernamental sobre o comercio internacional.

|

|

|

|

* Será enviado en 1 2 día de traballo cando o pagamento clara.

* Nós imos envialo seu enderezo de paypal. Se queres cambiar de dirección, por favor, envíe o seu enderezo correcto e número de teléfono para o meu e-mail [protexido por correo electrónico]

* Se os paquetes está baixo 2kg, que serán enviados vía correo aéreo, vai levar preto de 15-25days para a súa man.

Se o paquete é máis que 2kg, nós enviamos vía EMS, DHL, UPS, FedEx entrega rápida expresa, vai levar preto de 7 ~ 15days para a súa man.

Se o paquete de máis de 100kg, enviarémoslle vía DHL ou transporte aéreo. Isto levará uns 3 ~ 7days para a súa man.

Todos os paquetes son a forma China Guangzhou.

* O paquete enviarase como un "agasallo" e descartarase o menos posible, o comprador non terá que pagar o "IMPOSTO".

* Despois de navío, nós enviarémosche un correo electrónico e darlle o número de rastreamento.

|

|

|

Para garantía.

Contacte connosco --- >> Devólvenos o artigo --- >> Reciba e envíe outro substituto.

Nome: Liu Xiaoxia

Dirección: 305Fang HuiLanGe HuangPuDaDaoXi 273Hao TianHeQu Guangzhou China.

CEP: 510620

Teléfono: + 8618078869184

Por favor, retorne a este enderezo e escribir o seu paypal enderezo, nome, problema na nota: |

|